Nexvec™

Nexvec™

Uma solução de infraestrutura aberta pronta para uso para IA empresarial

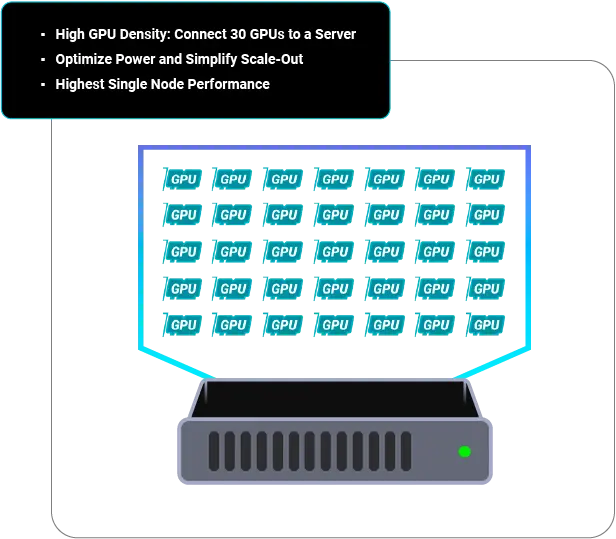

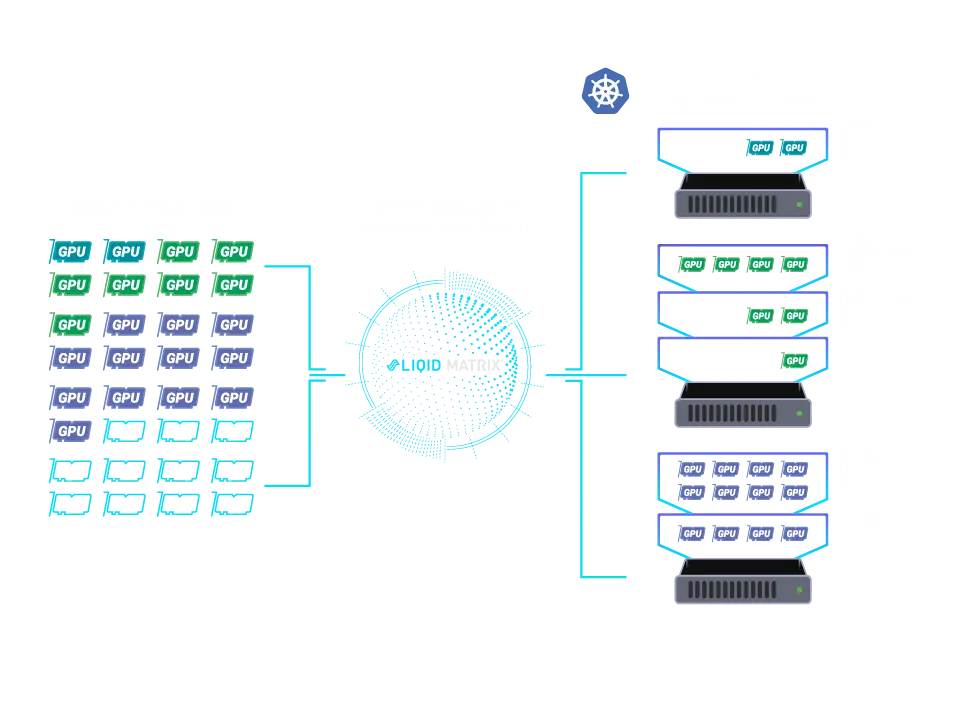

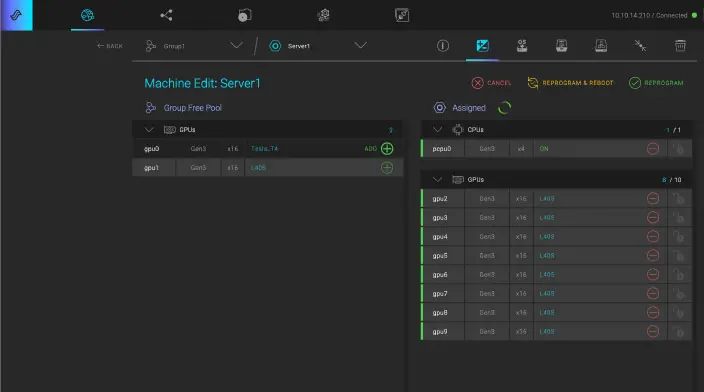

Computação componível

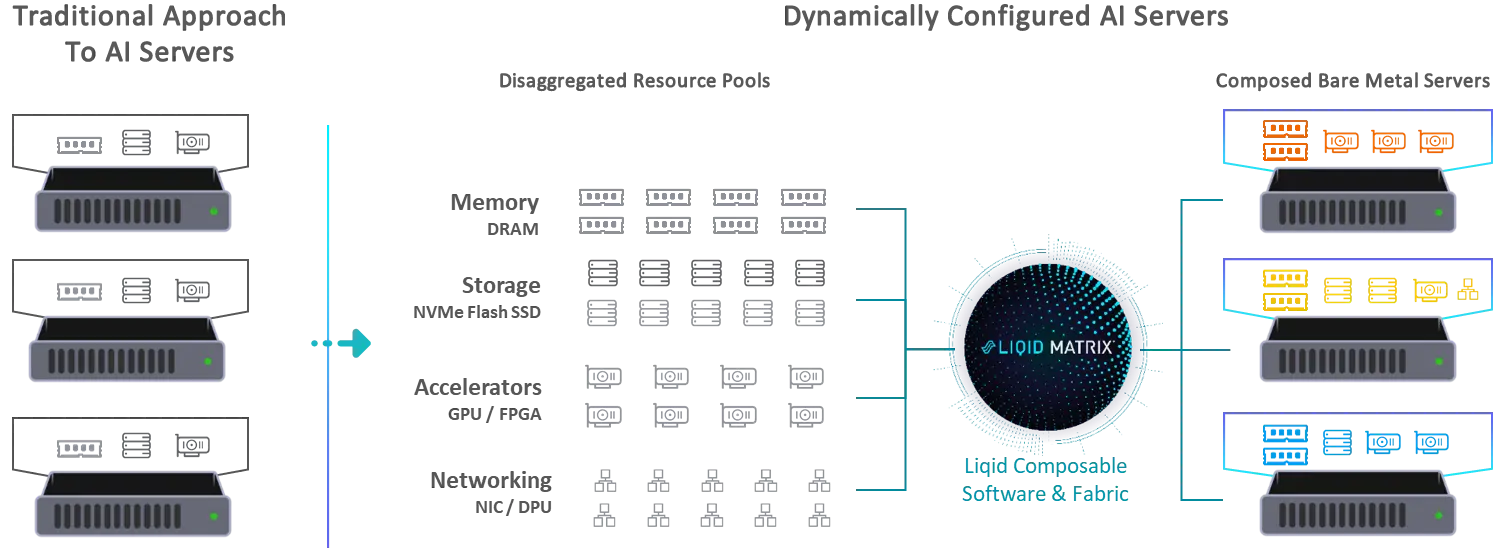

Em parceria com a Liqid, a solução de infraestrutura componível da Edgecore utiliza componentes de data center padrão do setor para criar uma arquitetura flexível e escalável, construída a partir de pools de recursos desagregados.

Recurso relacionado